La tecnología de redes neuronales artificiales está avanzando hacia un nuevo horizonte, en el cual una de sus aplicaciones permite crear virtualmente rostros humanos que nunca han existido. Y en el caso de dos redes que trabajan juntas, una tratará de generar una cara, mientras que la otra intentará juzgar si es real o falsa, según lo ejemplificó el ingeniero informático Tam Nguyen y recogió el viernes pasado The Conversation.

Este investigador de la Universidad de Dayton (Ohio, EE.UU.) explicó cómo funcionan en esta combinación el aprendizaje de las máquinas y el modelado computacional. A modo de ejemplo, citó un programa que, cada vez que el internauta actualiza la pantalla, genera en línea caras nuevas que supuestamente no pertenecen a personas reales.

La sucesión de imágenes continúa hasta que la segunda red diga que un rostro creado por la primera es falso. Y el programador que confeccionó este algoritmo, Phil Wang, está desarrollando también otros que hacen lo mismo con animales como caballos, aunque no siempre con el mismo éxito.

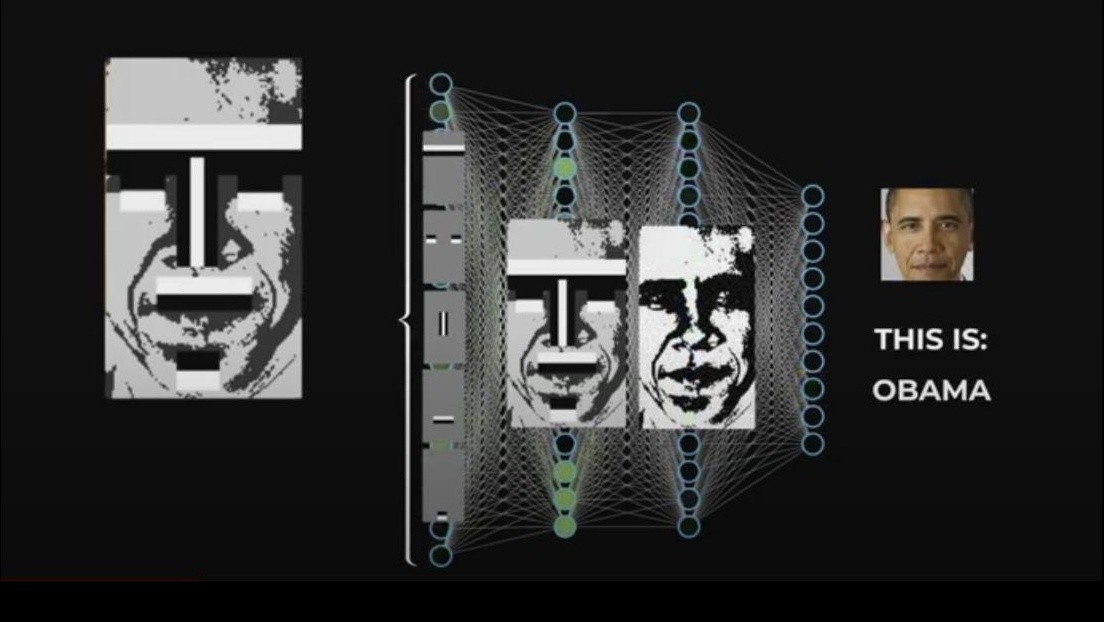

Nguyen recurrió también a otro ejemplo, que le permitió explicar cómo reconoce una red la cara del expresidente de EE.UU. Barack Obama tras entrenarse con un vasto número de fotos suyas. La red neuronal, dijo, intenta simular el cerebro humano, por lo que tiene muchas capas de lo que serían ‘neuronas’. Imágenes, videos, sonidos, textos, etc., entran en la primera capa y alimentan el conjunto de datos que pasa sucesivamente por todas las otras capas.

Tanto con Obama como con cualquier otra persona o con animales, la primera capa de neuronas divide la imagen en áreas claras y oscuras. Estos datos se introducen en la siguiente capa para reconocer los bordes, y la tercera reconoce las formas que adopta la combinación de bordes. Las redes pueden ser increíblemente complejas y recurren a millones de parámetros para clasificar y reconocer los datos que reciben de entrada.

Reconocimiento por personas y por máquinas

Los seres humanos también procesan datos masivos, recordó el informático. Una persona percibe alrededor de 30 imágenes por segundo, lo que significa 1.800 imágenes por minuto y más de 600 millones de imágenes por año. Es por eso, sostuvo, que deberíamos brindar a las redes neuronales una oportunidad similar de acceder a los datos masivos para así entrenarse.

Los vehículos autónomos representan otra aplicación de dichas redes: su inteligencia artificial necesita ver millones de imágenes y videos de todas las cosas que pueden surgir u ocurrir en la calle y saber qué es cada una de ellas.

El mismo sistema que permite a un usuario confirmar que no es un robot mediante un clic o varios en imágenes de pasos de cebra, también puede ser útil para ayudar a entrenar una red neuronal, dijo Nguyen. Solo después de ver millones de estos pasos desde todos los ángulos y en condiciones de iluminación diferentes, un coche autónomo podría reconocerlos al circular en la vida real.

Así, el reconocimiento de obstáculos por un producto de la subsidiaria de Google DeepMind, que funciona a través de redes neuronales, se muestra capaz de aprender por sí solo ante la tarea de ir de un punto A a un punto B.

Nguyen estimó también que la propagación actual de la tecnología de redes neuronales se debe a la popularidad de las unidades de procesamiento gráfico, los chips utilizados para procesar el contenido gráfico en videojuegos. Estos dispositivos han resultado también excelentes para procesar los datos necesarios en la ejecución de esas redes.

Fuente RT